аши машины становятся все более интеллектуальными и способны выполнять независимые задачи, и этим они обязаны быстро развивающимся областям искусственного интеллекта и машинного обучения. Однако обе области невероятно сложны и требуют времени и усилий для лучшего понимания.

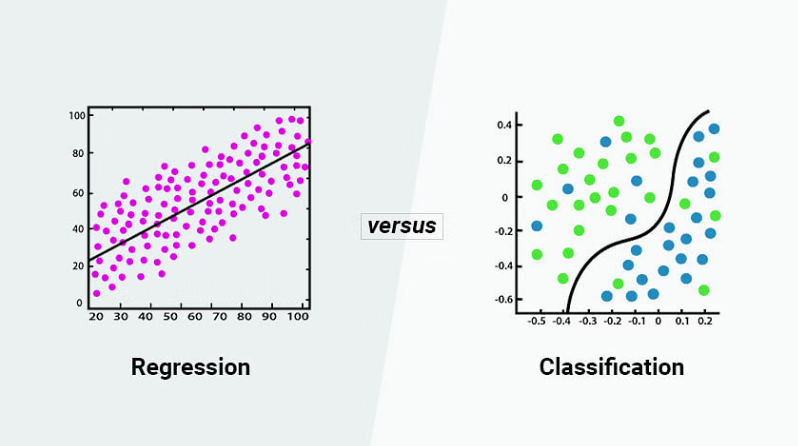

В этой статье рассматривается сравнение регрессии с Классификацией в машинном обучении, включая определения, типы, различия и варианты использования.

Ведущий лидер в области информационных технологий, IBM определяет машинное обучение как “… отрасль искусственного интеллекта (ИИ) и информатики, которая фокусируется на использовании данных и алгоритмов для имитации того, как люди учатся, постепенно повышая его точность”.

Алгоритмы регрессии и классификации известны как алгоритмы обучения под наблюдением и используются для прогнозирования в машинном обучении и работы с помеченными наборами данных. Однако их разный подход к задачам машинного обучения является точкой расхождения.

Теперь давайте более подробно рассмотрим соотношение регрессии и классификации.

- Объяснена регрессия в машинном обучении

- Объяснена классификация в машинном обучении

- Типы регрессии

- Типы классификации

- Разница между регрессом и Классификация

- Что вообще такое алгоритм дерева решений?

- В чем разница между классификацией и деревом регрессии?

- Функциональность

- Регрессия против Классификация: преимущества перед стандартными деревьями решений

- Недостатки деревьев классификации и регрессии

- При использовании регрессионного и Классификация

- Дерево решений – это регрессия или классификационная модель?

Объяснена регрессия в машинном обучении

Регрессия находит корреляции между зависимыми и независимыми переменными. Таким образом, алгоритмы регрессии помогают прогнозировать непрерывные переменные, такие как цены на жилье, рыночные тенденции, погодные условия, цены на нефть и газ (критическая задача в наши дни!) и т.д.

Задача алгоритма регрессии – найти функцию сопоставления, чтобы мы могли сопоставить входную переменную ”x” с непрерывной выходной переменной “y”.

Объяснена классификация в машинном обучении

С другой стороны, Классификация – это алгоритм, который находит функции, помогающие разделить набор данных на классы на основе различных параметров. При использовании алгоритма классификации компьютерная программа обучается на основе обучающего набора данных и классифицирует данные по различным категориям в зависимости от того, что она узнала.

Алгоритмы классификации находят функцию сопоставления для сопоставления входных данных “x” с дискретными выходными данными “y”. Алгоритмы оценивают дискретные значения (другими словами, двоичные значения, такие как 0 и 1, да и нет, истина или ложь) на основе определенного набора независимых переменных. Другими словами, алгоритмы классификации предсказывают вероятность наступления события путем подгонки данных к логит-функции.

Алгоритмы классификации используются для таких вещей, как классификация электронной почты и спама, прогнозирование готовности клиентов банка выплачивать свои кредиты и идентификация раковых опухолевых клеток.

Типы регрессии

Вот типы алгоритмов регрессии, которые обычно встречаются в области машинного обучения:

- Регрессия дерева решений: Основная цель этой регрессии – разделить набор данных на более мелкие подмножества. Эти подмножества создаются для построения значения любой точки данных, связанной с постановкой задачи.

- Регрессия основных компонентов: Этот метод регрессии широко используется. Существует множество независимых переменных, или в ваших данных существует мультиколлинеарность.

- Полиномиальная регрессия: этот тип соответствует нелинейному уравнению с использованием полиномиальных функций независимой переменной.

- Регрессия случайного леса: Регрессия случайного леса широко используется в машинном обучении. Для прогнозирования результата используется несколько деревьев решений. Случайные точки данных выбираются из заданного набора данных и используются для построения дерева решений с помощью этого алгоритма.

- Простая линейная регрессия: Этот тип является наименее сложной формой регрессии, где зависимая переменная является непрерывной.

- Опорная векторная регрессия: этот тип регрессии решает как линейные, так и нелинейные модели. Он использует нелинейные функции ядра, такие как полиномы, для нахождения оптимального решения для нелинейных моделей.

Типы классификации

А вот типы алгоритмов классификации, обычно используемых в машинном обучении:

- Классификация по дереву принятия решений: этот тип разделяет набор данных на сегменты на основе определенных функциональных переменных. Пороговые значения для разделения обычно представляют собой среднее значение или вид рассматриваемой функциональной переменной, если они являются числовыми.

- K-ближайшие соседи: этот тип классификации идентифицирует K ближайших соседей к данной точке наблюдения. Затем он использует K баллов для оценки пропорций каждого типа целевой переменной и прогнозирует целевую переменную с наибольшим коэффициентом.

- Логистическая регрессия: Этот тип классификации не является сложным, поэтому его можно легко освоить с минимальной подготовкой. Он предсказывает вероятность того, что Y будет связан с входной переменной X.

- Наивный байесовский алгоритм: Этот классификатор является одним из самых эффективных и в то же время простейших алгоритмов. Это основано на теореме Байеса, которая описывает, как вероятность события оценивается на основе предыдущего знания условий, которые могут быть связаны с событием.

- Классификация случайного леса: случайный лес обрабатывает множество деревьев решений, каждое из которых предсказывает значение вероятности целевой переменной. Затем вы получаете окончательный результат путем усреднения вероятностей.

- Машины опорных векторов: В этом алгоритме используются классификаторы опорных векторов с захватывающим изменением, что делает его идеальным для оценки нелинейных границ принятия решений. Этот процесс возможен за счет расширения пространства переменных объектов за счет использования специальных функций, известных как ядра.

Разница между регрессом и Классификация

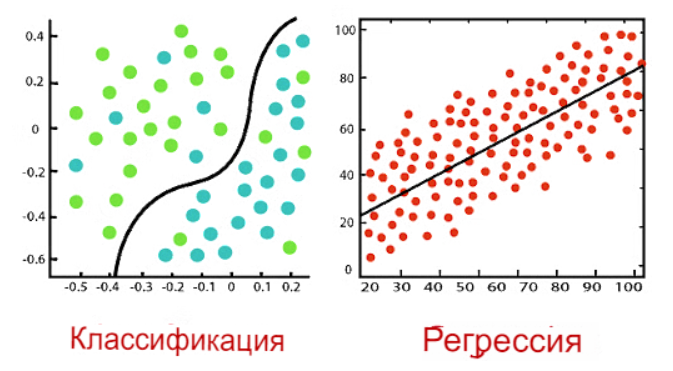

Это изображение, любезно предоставленное Javatpoint, иллюстрирует сравнение алгоритмов классификации и регрессии.

Эта таблица показывает различия между регрессом и Алгоритмы классификации.

| Алгоритмы регрессии | Алгоритмы классификации |

| Выходная переменная должна иметь либо непрерывный характер, либо реальное значение. | Выходная переменная должна быть дискретным значением. |

| Задачей алгоритма регрессии является сопоставление входного значения (x) с непрерывной выходной переменной (y). | Задача алгоритма классификации – сопоставить входное значение x с дискретной выходной переменной y. |

| Они используются с непрерывными данными. | Они используются с дискретными данными. |

| В нем делается попытка найти наиболее подходящую линию, которая более точно предсказывает результат. | Классификация пытается найти границу принятия решения, которая разделяет набор данных на разные классы. |

| Регрессионные алгоритмы решают регрессионные задачи, такие как прогнозы цен на жилье и погоды. | Алгоритмы классификации решают такие задачи классификации, как идентификация нежелательных электронных писем, обнаружение раковых клеток и распознавание речи. |

| Далее мы можем разделить алгоритмы регрессии на линейную и нелинейную регрессию. | Далее мы можем разделить алгоритмы классификации на двоичные классификаторы и многоклассовые классификаторы. |

Теперь, когда мы четко обозначили различия между алгоритмами классификации и регрессии, пришло время посмотреть, как они соотносятся с деревьями решений. Но прежде чем мы это сделаем, нам нужно задать важный вопрос.

Что вообще такое алгоритм дерева решений?

Мы можем классифицировать алгоритмы машинного обучения на два типа: контролируемые и неконтролируемые. Деревья принятия решений – это контролируемый алгоритм машинного обучения. Например, деревья принятия решений – это контролируемый алгоритм машинного обучения.

Алгоритмы дерева решений – это операторы if-else, используемые для прогнозирования результата на основе доступных данных.

Вот пример дерева решений, любезно предоставленный. Мы можем использовать это дерево решений, чтобы предсказать сегодняшнюю погоду и посмотреть, стоит ли устраивать пикник.

Теперь, когда у нас есть четкое определение базового дерева решений, мы готовы углубиться в классификацию и деревья регрессии.

В чем разница между классификацией и деревом регрессии?

Деревья классификации и регрессии, известные под общим названием CART, описывают алгоритмы дерева решений, используемые в задачах обучения классификации и регрессии. Лео Брейман, Джером Фридман, Ричард Олшен и Чарльз Стоун представили методологию классификации и дерева регрессии в 1984 году.

Дерево классификации – это алгоритм либо с фиксированной, либо с категориальной целевой переменной. Затем мы можем использовать алгоритм для определения наиболее вероятного “класса”, к которому, вероятно, попадет целевая переменная. Эти алгоритмы используются для ответов на вопросы или решения таких проблем, как “Кто с наибольшей вероятностью подпишется на эту акцию?” или “Кто пройдет или не пройдет этот курс?”

Оба этих вопроса представляют собой простые бинарные классификации. Категориальная зависимая переменная принимает только одно из двух возможных взаимоисключающих значений. Однако могут быть случаи, когда вам нужен прогноз, учитывающий несколько переменных, например “На какую из этих четырех рекламных акций люди, вероятно, подпишутся?” В этом случае категориальная зависимая переменная имеет несколько значений.

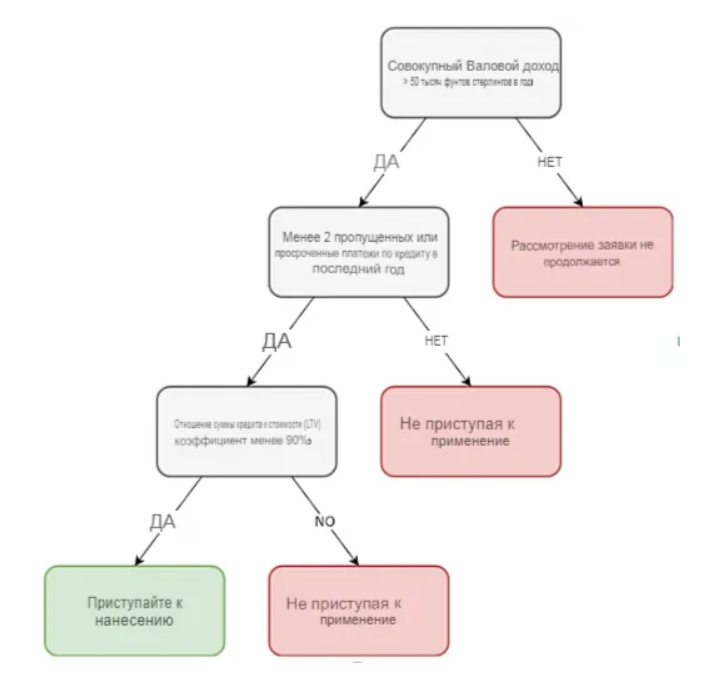

Вот пример дерева классификации, которое использовал бы ипотечный кредитор, любезно предоставленный Datasciencecentral.

Дерево регрессии описывает алгоритм, который принимает упорядоченные значения с непрерывными значениями и предсказывает значение. Например, вы можете захотеть предсказать цену продажи кондоминиума, непрерывную зависимую переменную.

Цена продажи будет зависеть от постоянных факторов, таких как площадь помещения, и категориальных факторов, таких как стиль кондоминиума, местоположение объекта недвижимости и подобных факторов.

Вот пример дерева регрессии, любезно предоставленный Rpub. В этом дереве рассчитываются зарплаты бейсболистов.

Что касается фактических различий, деревья классификации используются для решения задач, связанных с результатами классификации, а деревья регрессии работают с задачами типа прогнозирования. Но давайте подробнее рассмотрим различия.

Функциональность

Деревья классификации разделяют набор данных на основе однородности, такой как пара переменных. Например, мы могли бы использовать две переменные, такие как возраст и пол. Если данные обучения показали, что 85 процентам мужчин понравился определенный фильм, данные в этот момент разделяются, и пол становится верхним узлом в дереве. Такое разделение делает информацию на 85% чистой.

Деревья регрессии соответствуют целевой переменной с использованием всех независимых переменных. Затем данные по каждой независимой переменной разделяются в нескольких точках. Ошибка между прогнозируемыми и фактическими значениями возводится в квадрат в каждой точке для получения суммы квадратов ошибок, или SSE. Этот SSE сравнивается по всем переменным, и точка или переменная с наименьшим SSE становится точкой разделения, и процесс продолжается рекурсивно.

Регрессия против Классификация: преимущества перед стандартными деревьями решений

Как Классификационные, так и регрессионные деревья принятия решений генерируют точные прогнозы с использованием условий if-else . Их преимущества включают:

- Простые результаты: эти результаты легко наблюдать и классифицировать, что упрощает их оценку или объяснение другим людям.

- Они нелинейные и непараметрические: поскольку оба дерева имеют дело с упрощенными результатами, они позволяют избежать неявных предположений, что делает их хорошо подходящими для функций интеллектуального анализа данных.

- Деревья неявно выполняют выбор объектов: отбор переменных, также называемый выбором объектов, жизненно важен для аналитики. Несколько верхних узлов дерева решений являются наиболее важными, поэтому эти деревья решений автоматически выполняют выбор объектов.

Недостатки деревьев классификации и регрессии

Ни одна система не идеальна. Классификация и регрессионные деревья принятия решений сопряжены со своими проблемами и ограничениями.

- Они склонны к переобучению: Переобучение происходит, когда дерево учитывает шум, обнаруженный в большинстве данных, и приводит к неточностям.

- Они склонны к высокой дисперсии: даже незначительная дисперсия в данных может привести к высокой дисперсии результирующего прогноза, создавая нестабильный результат.

- Обычно они имеют низкую предвзятость: сложные деревья решений имеют характерно низкую предвзятость, что затрудняет добавление новых данных.

При использовании регрессионного и Классификация

Мы используем деревья классификации, когда набор данных должен быть разделен на классы, принадлежащие переменной ответа. В большинстве случаев этими классами являются “Да” или “Нет”. Таким образом, существует всего два класса, и они взаимоисключают друг друга. Конечно, иногда классов может быть больше двух, но в таких случаях мы просто используем вариант алгоритма дерева классификации.

Однако мы используем деревья регрессии, когда у нас есть непрерывные переменные отклика. Например, если переменной отклика является что-то вроде значения объекта или сегодняшней температуры, мы используем дерево регрессии.

Дерево решений – это регрессия или классификационная модель?

Легко определить, какая модель какая. Короче говоря, регрессионная модель дерева решений используется для прогнозирования непрерывных значений, в то время как модель дерева решений классификации имеет дело с бинарной ситуацией “или-или”.